Étude de législation comparée n° 309 - septembre 2022

Étude au Format PDF (430 Koctets)

-

I. L'ALLEMAGNE

-

II. L'AUSTRALIE

-

III. LE ROYAUME-UNI

Septembre 2022

- LÉGISLATION COMPARÉE -

NOTE

sur

LES CONDITIONS D'ACCÈS

DES MINEURS À

LA PORNOGRAPHIE

_____

Allemagne - Australie - Royaume-Uni

_____

Cette note a été réalisée à la demande de la délégation aux droits des femmes et à l'égalité des chances entre les hommes et les femmes.

Le rapport de la délégation est disponible sur le site du Sénat : http://www.senat.fr/notice-rapport/2021/r21-900-1-notice.html

AVERTISSEMENT

Ce document constitue un instrument de travail élaboré à la demande des sénateurs, à partir de documents en langue originale, par la Division de la Législation comparée de la direction de l'initiative parlementaire et des délégations. Il a un caractère informatif et ne contient aucune prise de position susceptible d'engager le Sénat.

L'ACCÈS DES MINEURS

AUX CONTENUS

PORNOGRAPHIQUES

À la demande de la délégation aux droits des femmes et à l'égalité des chances entre les femmes et les hommes, la Division de la Législation comparée du Sénat a réalisé une étude sur les conditions d'accès des personnes mineures à la pornographie, dont les contenus en ligne, en Allemagne, en Australie et au Royaume-Uni.

Dans ces trois pays, l'accès à la pornographie est réservé aux adultes. Cependant, la diffusion de contenus à caractère pornographique sur Internet, souvent par des fournisseurs basés à l'étranger, remet en question l'effectivité de l'interdiction aux mineurs et montre, s'agissant de l'Allemagne et de l'Australie, les limites de la co-régulation entre puissance publique et secteur privé.

Parmi les trois pays étudiés, seule l'Allemagne exige actuellement la mise en place d'un système de vérification pour accéder aux sites pornographiques. Après avoir écarté un tel système dans le projet de loi sur la sécurité en ligne adopté en 2021, le gouvernement australien étudie actuellement cette possibilité. Par ailleurs, au Royaume-Uni, un nouveau projet de loi instituant une obligation de restriction d'accès aux contenus pornographiques en ligne est en cours d'examen par le parlement, après l'échec de la loi de 2017 sur l'économie numérique, instituant un régulateur chargé de la vérification de l'âge.

En Allemagne, l'obligation de vérification de l'âge pour accéder à des sites pornographiques a été complétée par de nouvelles mesures de prévention concernant les plateformes en ligne interactives. Depuis 2019, les autorités régulatrices des médias de certains Länder , soutenues par la Commission à la protection de la jeunesse, ont également multiplié les recours à l'encontre des sites pornographiques afin de faire respecter l'obligation de vérification de l'âge par les sites internet basés à l'étranger, y compris en prononçant une mesure de blocage par les fournisseurs d'accès à Internet.

I. L'ALLEMAGNE

En Allemagne, le droit de la protection de la jeunesse dans les médias se caractérise, d'une part, par sa complexité, inhérente au partage des compétences entre l'État fédéral et les Länder selon les différents types de médias et, d'autre part, par le recours à la co-régulation avec le secteur privé.

L'offre de contenus pornographiques aux mineurs est interdite par le code pénal. Par conséquent, l'accès à de tels contenus est, en principe, réservé à des groupes fermés d'utilisateurs, âgés de plus de 18 ans. En pratique, les contenus pornographiques sont souvent accessibles sans aucune vérification de l'âge, à partir de sites internet ayant leur siège à l'étranger.

Face à ce constat, une révision de la loi fédérale sur la protection de la jeunesse a été adoptée en 2021 tandis qu'au niveau des Länder , des actions ont été lancées depuis 2019 pour garantir l'effectivité des normes de protection existantes.

A. LES DISPOSITIONS NORMATIVES VISANT À PROTÉGER LES JEUNES DE CERTAINS CONTENUS EN LIGNE

Aux termes de l'article 184 du code pénal allemand 1 ( * ) , l'offre et la mise à disposition de contenus pornographiques à des personnes mineures âgées de moins de 18 ans ou la diffusion de tels contenus dans un lieu accessible aux mineurs sont des délits pénaux, passibles d'une peine d'emprisonnement pouvant aller jusqu'à un an ou d'une amende.

Les dispositifs de protection des mineurs face aux contenus inappropriés ou dangereux - dont les contenus pornographiques - reposent, d'une part, sur la loi fédérale relative à la protection de la jeunesse et, d'autre part, sur l'accord entre les Länder sur la protection de la dignité humaine et la protection des jeunes dans les médias audiovisuels et numériques.

1. La loi fédérale relative à la protection de la jeunesse

À l'origine, la loi fédérale du 23 juillet 2002 relative à la protection de la jeunesse 2 ( * ) traite de la protection des enfants et des adolescents dans l'espace public (restaurants, salles de jeux, etc.) et de la limitation de la diffusion de certains contenus dans les médias sur support (presse écrite, vidéos, CD-Rom et DVD). Les dispositions relatives à la protection de la jeunesse face aux médias audiovisuels ( Rundfunk ) et sur Internet ( Telemedien ) sont prévues dans l'accord des Länder du 8 mars 2002 sur la protection de la dignité humaine et de la jeunesse dans les médias audiovisuels et numériques ( Jugendmedienschutz-Staatsvertrag , ci-après JMStV) 3 ( * ) . Cette distinction juridique selon le type de média s'expliquait par la répartition des compétences entre l'État fédéral et les Länder 4 ( * ) .

Conformément au contrat de coalition des partis au pouvoir (CDU/CSU et SPD) pour la 19 e législature, la loi fédérale sur la protection de la jeunesse a été amendée en 2021 en vue de l'adapter à la réalité des médias contemporains et de renforcer le niveau de protection. Constatant le phénomène de « convergence des médias » selon lequel les canaux de diffusion ne peuvent plus être distingués pour un même contenu, le champ d'application de la loi a été étendu à la diffusion des médias en ligne ( Telemedien ). La répartition des compétences a également été clarifiée : l'État fédéral est responsable de la définition du cadre général en matière de prévention et de protection et de la jeunesse dans les médias, tandis que les Länder demeurent compétents pour mettre en oeuvre les mesures individuelles de suivi des contenus.

Selon l'article 15 alinéa 2 de la loi sur la protection de la jeunesse, les contenus pornographiques relèvent automatiquement de la catégorie des médias portant gravement atteinte aux jeunes. Dès lors, et ce conformément à l'article 184 du code pénal, ces contenus ne peuvent être proposés, donnés ou rendus accessibles aux enfants et adolescents mineurs dans les médias sur support et dans les médias en ligne, ainsi que dans les lieux accessibles aux jeunes et les commerces de détail.

La définition de la pornographie en droit allemand

Le concept de pornographie n'est pas défini par la loi allemande. La jurisprudence de la cour suprême fédérale ( Bundesgerichtshof , BGH) estime qu'« Une représentation doit être considérée comme pornographique si, ignorant les autres rapports humains, elle met les rapports sexuels au premier plan d'une manière grossière ou outrancière et que sa tendance générale vise exclusivement ou principalement l'intérêt du spectateur pour les choses sexuelles » (voir BGH St 23,44; 37,55).

Une distinction est faite par le BGH entre la pornographie dite « dure » (pornographie juvénile, animale ou violente) et la pornographie dite « simple ».

Source : KJM, Tätigkeitsbericht März 2019 - Februar 2021

La principale mesure de prévention de la diffusion de contenus pornographiques aux mineurs passe par l'obligation pour les prestataires de services de s'assurer que ces contenus ne sont accessibles qu'aux adultes, conformément à l'article 4 de l'accord entre les Länder sur la protection de la jeunesse dans les médias (voir infra ).

S'agissant plus spécifiquement des contenus accessibles sur Internet, la loi sur la protection de la jeunesse prévoit l'obligation pour les prestataires de services 5 ( * ) de mettre en place un mécanisme de plainte (§ 24a, alinéa 1) permettant aux utilisateurs de signaler toute offre non autorisée telle que définie à l'article 4 de l'accord des Länder - c'est-à-dire des contenus portant atteinte à la jeunesse, dont les contenus pornographiques - ainsi que tout contenu pouvant porter préjudice au développement de l'enfant ou de l'adolescent 6 ( * ) . Ce mécanisme de plainte recoupe en partie l'obligation prévue à l'article 3 de la loi de 2017 sur les réseaux sociaux ( Netzwerkdurchsetzungsgesetz , ci-après NetzDG) 7 ( * ) , tout en étant plus exigeante dans la mesure où il ne concerne pas seulement les contenus interdits. Cette obligation ne s'applique pas si l'offre en Allemagne compte moins d'un million d'utilisateurs.

Tenant compte de l'utilisation croissante par les enfants et les jeunes de plateformes numériques interactives, dont le contenu peut être généré par les utilisateurs eux-mêmes, l'article 24a de la loi sur la protection de la jeunesse, tel que révisé en 2021, introduit deux nouvelles mesures de prévention qui peuvent s'avérer pertinentes pour prévenir l'accès à des contenus pornographiques par des mineurs :

- la mise à disposition par le prestataire d'un système de notation des contenus audiovisuels générés par défaut par les utilisateurs, incitant ces derniers à noter la pertinence des contenus réservés aux adultes correspondant à la catégorie d'âge « plus de 18 ans » ;

- et, lorsque l'utilisateur a classé des vidéos générées automatiquement comme étant réservées aux adultes, la mise à disposition par le fournisseur de moyens techniques de vérification de l'âge pour ces contenus.

Ces obligations ne s'appliquent pas aux prestataires de services en ligne dont les offres ne s'adressent pas aux enfants et aux adolescents et ne sont généralement pas utilisés par eux (par exemple, les sites et réseaux sociaux à caractère professionnel), ni aux offres journalistiques et éditoriales, dont le prestataire est directement responsable de la création des contenus 8 ( * ) . En revanche, la révision de 2021 précise que les prestataires de services qui ne disposent pas de siège social en Allemagne - notamment les grandes plateformes internationales - sont soumis aux obligations de prévention de la loi sur la protection de la jeunesse.

L'Agence fédérale pour la protection des enfants et des adolescents dans les médias ( Bundeszentrale für Kinder- und Jugendmedienschutz , ci-après BzKJ) 9 ( * ) est principalement responsable de la tenue de la liste des médias portant atteinte à la jeunesse (§ 17a JuSchG). Depuis 2021, elle est également chargée de contrôler la mise en oeuvre et l'adéquation des mesures de prévention prises par les plateformes sur Internet (§ 24b JuSchG). Si l'Agence fédérale constate qu'un prestataire n'a pas pris de mesures de prévention ou que ces mesures sont insuffisantes, une procédure contradictoire s'engage. Si le prestataire ne donne pas suite aux demandes de l'agence à l'issue de cette phase contradictoire, la BzKJ peut ordonner des mesures conservatoires et infliger une amende pouvant aller jusqu'à 50 millions d'euros 10 ( * ) .

2. L'accord entre les Länder sur la protection de la jeunesse dans les médias

L'accord entre les Länder du 8 mars 2002 sur la protection de la jeunesse dans les médias - JMStV - a pour objectif d'offrir aux enfants et adolescents 11 ( * ) une protection uniforme sur le territoire allemand contre les offres qui entravent ou mettent en danger leur développement ou leur éducation ou violent la dignité humaine ou d'autres droits protégés par le code pénal, dans les médias audiovisuels et sur Internet.

Les nouvelles obligations introduites lors de la révision de la loi fédérale sur la protection de la jeunesse n'ont pas d'impact sur l'accord JMStV, dont les règles sont confirmées et demeurent pleinement applicables aux médias audiovisuels et en ligne.

L'accord JMStV classe les offres de contenus audiovisuels ou numériques en trois catégories :

i) les contenus interdits en toutes circonstances (§ 4 alinéa 1 JMStV). Il s'agit de contenus interdits par le code pénal, même aux adultes, comme par exemple les contenus faisant l'apologie de la violence et des discours de haine, le matériel de propagande et la pornographie enfantine, juvénile, violente et impliquant des animaux ;

ii) les contenus interdits à certains groupes (§ 4 alinéa 2 JMStV). Entrent principalement dans cette catégorie la pornographie pour adultes, les contenus classés comme réservés aux adultes en raison du risque pour le développement de l'enfant ou du jeune et les contenus figurant sur la liste des contenus portant atteinte à la jeunesse établie par l'agence fédérale BzKJ. Les fournisseurs de contenus relevant de cette catégorie doivent s'assurer qu'ils ne sont accessibles qu'aux adultes, par des groupes fermés d'utilisateurs, notamment au moyen de systèmes de vérification de l'âge (voir infra ) ;

iii) les contenus pouvant altérer le développement (§ 5 alinéa 4 JMStV). Il s'agit de contenus autorisés mais qui peuvent inhiber ou ralentir le développement des enfants ou adolescents en ce qu'ils tendent à les désorienter socialement ou sexuellement, à encourager des attitudes violentes ou à susciter des peurs excessives. Les fournisseurs de tels contenus doivent veiller à ce que les mineurs des tranches d'âge respectives ne puissent pas accéder aux contenus qui leur sont déconseillés, par exemple à l'aide de filtres ou de la limitation des horaires de diffusion.

La mise en oeuvre de l'accord JMStV repose sur un système d' « autorégulation réglementée » ( regulierte Selbstregulierung ) dans lequel les rôles sont répartis de la façon suivante :

- la Commission pour la protection de la jeunesse dans les médias ( Kommission für Jugendmedienschutz , ci-après KJM), en tant qu'instance commune aux autorités régulatrices des médias des Länder , contrôle le respect des dispositions de l'accord JMStV et propose aux autorités des Länder des mesures individuelles à prendre à l'encontre des prestataires de services audiovisuels et sur Internet. La KJM est aussi chargée de déterminer les heures de diffusion de certains contenus, d'approuver les technologies de chiffrement et de blocage, de définir les critères de reconnaissance des programmes de protection de la jeunesse et de soumettre à l'agence BzKJ des demandes d'indexation de contenus portant atteinte à la jeunesse ou interdits ;

- les entreprises prestataires de services peuvent faire appel à des organismes d'autorégulation volontaire ( Einrichtungen der Freiwilligen Selbstkontrolle ), reconnus par la KJM 12 ( * ) , afin de vérifier le contenu de leurs offres et de s'assurer du respect des règles de protection de la jeunesse (§ 19 JMStV).

Le concept « d'autorégulation

réglementée »

dans le droit de la protection de la

jeunesse allemand

Le système d'« autorégulation réglementée » ( regulierte Selbstregulierung ) signifie que les prestataires eux-mêmes sont responsables d'assurer la protection des enfants et des jeunes lors de la conception de leur offre. Avant de diffuser des contenus, ils doivent vérifier sous leur propre responsabilité si leur offre peut nuire au développement ou porter atteinte aux enfants et aux jeunes et prendre les mesures de protection appropriées.

Pour s'acquitter de leur responsabilité, les prestataires peuvent recourir à des organismes d'autorégulation volontaire ( Einrichtungen der Freiwilligen Selbstkontrolle ). Si les prestataires se conforment aux exigences des organismes d'autorégulation reconnus et si les décisions desdits organismes demeurent dans la marge d'appréciation qui leur est conférée par la loi, les mesures de surveillance du fournisseur par la KJM ou l'autorité régulatrice des médias du Land sont exclues.

Source : KJM, Tätigkeitsbericht März 2019 - Februar 2021

B. LA MISE EN oeUVRE DES MESURES DE LIMITATION DE L'ACCÈS À LA PORNOGRAPHIE

Selon le droit de la protection de la jeunesse, certains contenus interdits aux mineurs, comme la pornographie, ne peuvent être diffusés à la télévision ou sur Internet que s'il est garanti qu'ils ne sont accessibles qu'à un groupe fermé d'utilisateurs, excluant les enfants et les adolescents. Cette garantie passe par le déploiement de systèmes de vérification de l'âge.

La Commission pour la protection de la jeunesse dans les médias (KJM), relevant des Länder , joue un rôle central dans l'évaluation des solutions techniques de vérification de l'âge ainsi que dans le contrôle du respect des normes de protection de la jeunesse. Constatant qu'en pratique de nombreux sites internet pornographiques sont librement accessibles, la KJM a renforcé ses exigences en matière de contrôle de l'âge et lancé plusieurs procédures à l'encontre de sites et de réseaux sociaux basés à l'étranger.

L'articulation avec les nouvelles compétences de l'Agence fédérale pour la protection de la jeunesse (BzKJ) concernant les plateformes numériques constitue un enjeu important pour les prochaines années.

1. Les moyens techniques de contrôle de l'âge

L'accord JMStV ne prévoit pas de procédure pour la reconnaissance des solutions techniques de vérification de l'âge ou de restriction d'accès à des groupes fermés d'utilisateurs. C'est pourquoi la KJM a développé sa propre procédure d'évaluation positive 13 ( * ) des solutions techniques de contrôle de l'âge. Elle peut également évaluer les nouvelles solutions techniques des entreprises, à la demande de ces dernières.

Constatant le manque d'effectivité de certains systèmes, la KJM a introduit, en décembre 2019, de nouveaux critères d'évaluation des solutions techniques de vérification de l'âge, plus exigeants. Ainsi, la vérification de l'âge pour les groupes fermés d'utilisateurs doit s'effectuer en deux étapes interconnectées 14 ( * ) :

- à travers au moins une identification personnelle, permettant de vérifier la majorité. Un « contact personnel entre personnes présentes » est considéré comme nécessaire pour minimiser les risques de contrefaçon et de contournement. Ce contact personnel peut être effectué par un contrôle du visage de la personne ( face-to-face Kontroll ), avec une comparaison des données figurant sur la pièce d'identité officielle. Dans certaines conditions, il est possible de se référer à un précédent contrôle de l'âge des personnes physiques effectué lors de l'ouverture d'un compte bancaire ou la signature d'un contrat de téléphonie mobile. Dans tous les cas, une simple présentation d'une copie de la carte d'identité ou une identification par webcam ne suffit pas (à moins qu'elle ne soit assortie d'un programme permettant de comparer les données biométriques de la pièce d'identité) ;

- et une authentification lors de chaque utilisation (session). L'authentification sert à garantir que seule la personne identifiée, et dont l'âge a été vérifié, a accès à un groupe d'utilisateurs fermé et vise à rendre plus difficile la transmission des autorisations d'accès à des tiers non autorisés. En principe, une authentification par mot de passe attribué personnellement peut suffire. La KJM encourage cependant des solutions techniques limitant la transmission de l'autorisation d'accès à des tiers non autorisés (par exemple, grâce à un hardware (puce de la pièce d'identité, carte SIM) associé à un mot de passe ou un code PIN à usage unique généré par un token ) 15 ( * ) .

Au mois de mars 2022, la KJM a conclu à une évaluation positive pour 90 solutions techniques (globales ou partielles) de vérification de l'âge 16 ( * ) . Parmi ces solutions figure un logiciel d'évaluation de l'âge au moyen de l'intelligence artificielle et de l'apprentissage automatique ( maschinelles Lernen ) : à l'aide de grands ensembles de données d'images faciales, le logiciel calcule la correspondance probable entre l'âge de la personne présentée et l'âge des personnes du jeu de données. Pour une plus grande sécurité, la KJM souligne que le seuil d'accès doit être fixé cinq ans au-dessus de celui spécifié par le JMStV (par exemple, pour accéder à un contenu réservé aux personnes de plus de 18 ans, les utilisateurs doivent être reconnus par le système comme ayant au moins 23 ans) 17 ( * ) . Dans son dernier rapport d'activité, la KJM recommande le développement continu de nouvelles solutions techniques plus efficaces 18 ( * ) .

Les organismes d'autorégulation jouent également un rôle important pour aider les entreprises dans le choix et la mise en place de systèmes de vérification de l'âge fiables. Pour les sites internet et plateformes de vidéos en ligne, l'organisme d'autorégulation réglementée des prestataires de services multimédia (FSM) propose à ses entreprises membres des tests et des certifications de contenus et de logiciels 19 ( * ) .

La KJM constate cependant que l'utilisation par les enfants et les adolescents de smartphones , pour accéder à des applications et des sites internet, rend le contrôle parental plus difficile et que les solutions techniques de protection ne sont pas encore suffisantes 20 ( * ) . Ceci a conduit la commission à envisager des instruments d'application de la loi inédits, pouvant aller jusqu'à des mesures de blocage d'accès de sites à l'encontre de fournisseurs d'accès à Internet.

2. Le contrôle exercé par la Commission pour la protection de la jeunesse (KJM)

Depuis 2019, la KJM a renforcé son action de surveillance, en partie déléguée au centre d'expertise jugendschutz.net , commun à l'État fédéral et aux Länder 21 ( * ) . Les procédures initiées par les autorités régulatrices de certains Länder ont conduit la KJM à lancer des procédures à l'encontre de plusieurs grandes plateformes de vidéos pornographiques et de réseaux sociaux dont le siège se situe à l'étranger.

En juin 2020, la KJM a statué sur trois procédures, lancées par l'autorité régulatrice des médias de Rhénanie-du-Nord-Westphalie contre des sites pornographiques basés à Chypre 22 ( * ) . Dans les trois cas, la KJM a constaté des violations des dispositions du JMStV, ces sites offrant des contenus pornographiques librement accessibles sans garantir que les enfants et les jeunes n'y ont pas accès. La KJM a par conséquent interdit la diffusion de ces offres sous leur forme actuelle. Selon le président de la KJM, « l'autorité régulatrice des médias de Rhénanie-du-Nord-Westphalie a déjà parcouru un long chemin en informant et en consultant une grande variété d'acteurs nationaux et étrangers. Ceci comprenait une audition des fournisseurs, en coordination avec le régulateur des médias chypriote. Si, malgré les décisions désormais prises par la KJM, il n'est toujours pas possible de convaincre les prestataires d'adapter leurs offres de manière conforme à la loi, la KJM est prête à poursuivre dans cette voie et à épuiser toutes les voies de recours disponibles. Il est inacceptable que des fournisseurs d'une telle portée, qui s'adressent spécifiquement à un public allemand, ignorent la loi allemande malgré la mise en danger évidente des enfants et des jeunes » 23 ( * ) .

En novembre 2021, le tribunal administratif de Düsseldorf a confirmé la compétence de la KJM pour prononcer cette mesure d'interdiction. Les fournisseurs avaient argué du fait que le siège des plateformes étant basé à Chypre, et non en Allemagne, les normes de protection de la jeunesse allemande ne trouvaient pas à s'appliquer. Le juge, à l'inverse, a estimé que le principe du pays d'origine ne trouvait exceptionnellement pas à s'appliquer, sous peine d'augmenter sensiblement le risque d'accès des mineurs aux contenus pornographiques 24 ( * ) . Face à l'inaction de certains de ces prestataires de sites internet, la KJM a introduit un nouveau recours devant le tribunal administratif supérieur (OVG) de Münster, actuellement pendant.

En outre, la KJM a décidé, en mars 2022, d'une mesure de blocage par les fournisseurs d'accès à Internet à l'encontre du site pornographique le plus utilisé en Allemagne, xHamster. Elle fait suite à une première décision de mars 2020, à la suite de laquelle l'autorité régulatrice des médias de Rhénanie-du-Nord-Westphalie avait demandé à la société Hammy Media Ltd basée à Chypre et fournisseur de xHamster, de rendre le site conforme à la loi et d'effectuer un contrôle de l'âge des utilisateurs. En l'absence de mise en conformité, la KJM a demandé aux autorités régulatrices des Länder où la société dispose de représentants d'ordonner des mesures de blocage du site aux cinq principaux fournisseurs d'accès à Internet en Allemagne 25 ( * ) . Pour la KJM, cette mesure de blocage constitue un moyen de dernier recours, qui a vocation à agir comme un signal vis-à-vis des autres fournisseurs de contenus pornographiques. « L'objectif de cette approche, au moins à moyen terme, est la mise en conformité des sites pornographiques - c'est-à-dire d'établir de nouveaux standards pour cette branche. Les interdictions d'accès sont des mesures qui ne peuvent être indifférentes aux sociétés pornographiques et qui contribuent à exercer une pression pour qu'elles vérifient l'âge de leurs utilisateurs » 26 ( * ) . Selon certains médias spécialisés, le fournisseur de la plateforme pornographique a contourné ce blocage en changeant simplement le nom de domaine pour l'Allemagne (.deu ou lieu de .de), la décision du régulateur allemand ne s'appliquant pas automatiquement à tous les domaines distribuant des contenus identiques (contrairement au droit applicable en matière de droits d'auteurs).

Détail de la procédure initiée par

l'autorité régulatrice des médias

de

Rhénanie-du-Nord-Westphalie à l'encontre de sites

pornographiques

« Selon le principe de la responsabilité graduée, une procédure est d'abord ouverte contre le fournisseur de contenus . Si celui-ci est basé dans un autre pays européen, le responsable des affaires européennes de la conférence des directeurs des autorités régulatrices des médias des Länder allemands (DLM) doit d'abord contacter le régulateur des médias étranger responsable avant toute intervention de l'autorité des médias du Land compétent. La Commission européenne est également impliquée dans ces procédures.

« Si le fournisseur de contenu ne peut être identifié ou qu'un acte administratif définitif contre lui ne peut y être exécuté en raison de son siège social à l'étranger, l'étape suivante consiste à intenter une action contre l'hébergeur .

« Conformément au § 2 de la loi sur les médias en ligne (TMG), est également responsable en tant que fournisseur de services toute personne juridique qui se contente de mettre à disposition des contenus numériques étrangers. Selon le § 20 (4) du JMStV, en lien avec le § 7 (3) TMG, les prestataires de services sont responsables de la suppression des informations ou du blocage de l'utilisation des informations ordonnés par l'administration, même s'ils n'avaient (jusqu'à présent) aucune connaissance de l'activité illégale. Les principes de responsabilité de l'article 14 de la directive 2000/31/CE (E-Commerce) ont été transposés au § 10 TMG. Conformément au § 20 paragraphe 1 et 4 JMStV, en lien avec le § 109 de l'accord entre les Länder sur les médias (MStV), les autorités régulatrices des Länder peuvent également prendre des mesures contre le prestataire de services pour bloquer les contenus de tiers conformément au § 10 TMG, à condition que le blocage soit techniquement possible et raisonnable et que les mesures à l'encontre du fournisseur de contenus soient irréalisables ou aient peu de chance d'aboutir.

« Étant donné que les hébergeurs sont, eux aussi, principalement basés dans d'autres pays européens, le responsable des affaires européennes de la DLM doit au préalable contacter ou consulter le régulateur des médias étranger responsable ainsi que la Commission européenne.

« Si les poursuites contre l'hébergeur n'aboutissent pas non plus, les autorités régulatrices des Länder doivent prendre en dernier ressort des mesures contre les fournisseurs d'accès à Internet afin qu'ils rendent l'accès aux sites internet illégaux beaucoup plus difficile grâce à un blocage DSN et protègent ainsi les enfants et les adolescents de contenus inadaptés.

« Afin d'agir efficacement contre le danger, les autorités régulatrices contactent d'abord les cinq plus gros fournisseurs d'accès en Allemagne (...). Les poursuites contre les autres fournisseurs d'accès suivront graduellement. »

Source : KJM, Tätigkeitsbericht März 2019 - Februar 2021

Outre les actions à l'encontre de sites pornographiques, la KJM et les autorités régulatrices des médias des Länder de Rhénanie-du-Nord-Westphalie et du Schleswig-Holstein ont pris, en 2020, des mesures contre plusieurs profils diffusant des contenus pornographiques sur le réseau social Twitter. Les détenteurs de ces profils n'ayant pu être identifiés, les autorités régulatrices des médias ont tenu Twitter responsable en tant qu'hébergeur. Twitter s'est par la suite assuré que ces profils ne puissent plus être consultés par les utilisateurs dont le profil est paramétré en Allemagne.

L'information des parents sur les solutions

techniques

de filtrage des appareils et des sites internet

Les paramètres de protection des enfants et de filtrage sur les ordinateurs, smartphones , sites internet et applications étant très variés et souvent difficiles à trouver pour les parents, les autorités régulatrices des médias de Brême, Bade-Wurtemberg et de Mecklembourg-Poméranie ont créé un portail internet (medien-kindersicher.de ) informant les parents sur les solutions techniques de filtrage pour enfants, pour les différents types et marques d'appareils et les principaux fournisseurs de contenus.

3. Les actions de l'Agence fédérale pour la protection de la jeunesse dans les médias (BzKJ)

À la suite de la révision de la loi fédérale sur la protection de la jeunesse, la nouvelle Agence fédérale pour la protection des enfants et des adolescents dans les médias (BzKJ) a vu ses compétences et ses moyens renforcés. Un an après l'entrée en vigueur de la loi, le recul demeure insuffisant pour apprécier l'efficacité des nouvelles dispositions, notamment les obligations concernant les contenus vidéo générés automatiquement sur Internet.

Le directeur de l'agence constatait, en mai 2022, que l'agence devait poursuivre le développement des liens et du dialogue avec les fournisseurs de contenus et les différents acteurs impliqués dans la protection des enfants et des jeunes dans les médias, en particulier la KJM, les organismes d'autorégulation volontaire et le centre jugendschutz.net .

Afin de servir de base à ce processus de dialogue, la BzKJ a publié, en mai 2022, une deuxième édition de l'atlas sur les dangers pour les enfants et les adolescents dans le monde numérique. La pornographie sur Internet y est identifiée comme l'un des dangers auxquels la jeunesse est confrontée. Selon des enquêtes réalisées en 2018, environ 2 % à 6 % des enfants entre 6 ans et 13 ans interrogés avaient été confrontés au moins une fois à des contenus pornographiques sur Internet. Chez les adolescents, 32 % des 14-15 ans et 47 % des 16-17 ans avaient vu au moins une fois une vidéo à caractère pornographique 27 ( * )

II. L'AUSTRALIE

Le gouvernement australien considère que « l'accès des mineurs à des services et contenus en ligne inappropriés pour leur âge ou potentiellement dangereux est une préoccupation majeure en matière de sécurité en ligne pour la communauté australienne » 28 ( * ) .

En 2017, une enquête menée par l'Institut australien des études familiales a indiqué que près de la moitié des enfants âgés de 9 à 16 ans étaient régulièrement exposés à des images sexuelles. En 2018, le Bureau du commissaire à la sécurité en ligne ( eSafety Commissioner ) a publié un rapport intitulé Parentalité et pornographie : les résultats de l'Australie, de la Nouvelle-Zélande et du Royaume-Uni , selon lequel 33 % des parents ont indiqué que l'accès à la pornographie était l'une de leurs principales préoccupations pour la sécurité en ligne des enfants. Ce rapport estime également que 40 % des expositions des mineurs à la pornographie était accidentelle.

Pourtant, la production et la vente de films pornographiques ou le chargement de telles vidéos sur Internet sont interdits dans la plupart des États australiens. Dans ces États, Le visionnage de contenus pornographiques classiques, hébergés sur des serveurs étrangers, n'est toutefois pas illégal.

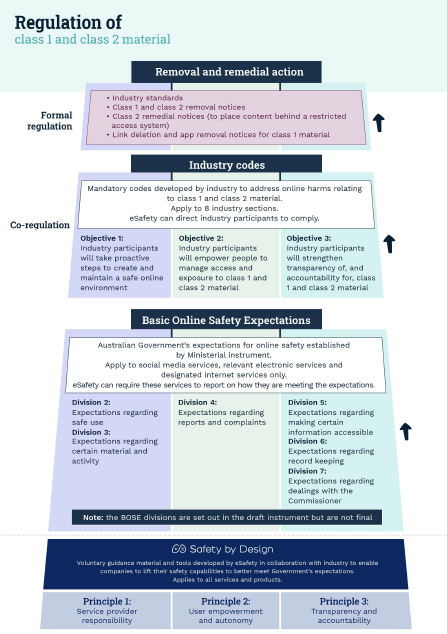

Afin de minimiser l'accès des enfants et adolescents aux contenus inappropriés et potentiellement dangereux, dont les contenus pornographiques, l'Australie a adopté, en 2021, une nouvelle loi sur la sécurité en ligne. L'approche retenue continue de reposer sur la co-régulation, tout en renforçant les pouvoirs du commissaire à la sécurité en ligne. S'agissant des contenus pornographiques, une proposition de mise en place d'un système obligatoire de vérification de l'âge est attendue en décembre 2022.

A. LA LOI SUR LA SÉCURITÉ EN LIGNE

Une nouvelle loi sur la sécurité en ligne (Online Safety Act) a été adoptée en 2021 et est entrée en vigueur le 23 janvier 2022 29 ( * ) . Elle complète et renforce les dispositions de la loi de 2015 ( Enhancing Online Safety Act 2015 ) et certaines parties de la loi sur les services audiovisuels de 1992 ( Broadcasting Services Act 1992 ). Elle modernise le système de classification des contenus en ligne, oblige les entreprises du numérique à adopter des codes de conduite règlementant l'accès aux contenus potentiellement dangereux et renforce les pouvoirs du commissaire à la sécurité en ligne « eSafety ».

1. La classification des contenus en ligne

Selon la loi sur la sécurité en ligne ( Part 9, Division 1 ) 30 ( * ) , les contenus en ligne illégaux et à accès restreint ( illegal and restricted online content ) désignent un large ensemble de contenus allant des contenus les plus dangereux, comme les images d'abus sexuel sur des enfants ou de terrorisme, à des contenus moins graves mais qui ne devraient pas être accessibles à des mineurs. Ils sont classés par référence au système national de classification ( National Classification Scheme 31 ( * ) ) qui s'applique aux films, publications et jeux informatiques. Ainsi :

- la « classe 1 » correspond aux contenus dont la classification serait refusée dans le système national ( Refused Classification, RC ), comme par exemple les contenus montrant des scènes de sexe, de toxicomanie, de crime, de cruauté, de violence ou des phénomènes révoltants ou odieux enfreignant les normes de moralité, de décence et de bienséance généralement admises par des adultes raisonnables, les contenus dépeignant de façon offensante une personne qui est ou semble être un mineur de moins de 18 ans (en particulier, les contenus pédopornographiques) ou encore les contenus incitants au crime ou à la violence ;

- la « classe 2 » est elle-même subdivisée en deux sous-catégories, à savoir la classe 2A comprenant les contenus classés « X18+ » (montrant des scènes d'activité sexuelle non simulée entre adultes consentants, c'est-à-dire de la pornographie dite « mainstream »), et la classe 2B comprenant des contenus classés « R18+ » (représentations d'activités sexuelles simulées, de nudité, de violence ou de consommation de drogue) 32 ( * ) , en vertu du système de classification nationale. Les contenus de classe 2 sont considérés comme inappropriés pour le grand public et/ou pour les enfants et adolescents de moins de 18 ans. Les films et vidéos classés X18+ sont interdits à la vente et à la location dans tous les États australiens, à l'exception du Territoire de la Capitale australienne (Canberra) et du Territoire du Nord 33 ( * ) . Dans tous les États, le fait de regarder des contenus pornographiques en ligne n'est cependant pas répréhensible pour les adultes.

Le ministre compétent en matière de télécommunications peut adopter des « attentes minimales en matière de sécurité en ligne » ( Basic Online Safety Expectations, Online Safety Act, Part 4 ) précisant les attentes à l'égard des fournisseurs de services sur Internet. Il est notamment attendu que ceux-ci « adoptent des mesures raisonnables pour minimiser l'accès à des contenus de classe 1 (...) » et, s'agissant des contenus de classe 2, « pour s'assurer que des mesures technologiques ou d'une autre nature sont mises en place pour restreindre l'accès des enfants à ces contenus » 34 ( * ) . La loi ne rend pas obligatoire la mise en place d'un système de restriction d'accès ou de vérification de l'âge pour les contenus de classe 2, ni ne prescrit de solution technique spécifique mais attend que les entreprises du numérique concernées adoptent des mesures minimales 35 ( * ) . De plus, elle donne au commissaire à la sécurité en ligne le pouvoir d'ordonner la mise en place d'un système d'accès restreint pour des contenus de classe 2B (c'est-à-dire inappropriés pour les moins de 18 ans) hébergés en Australie (cf. infra ).

2. L'adoption de codes de conduite par l'industrie

Dans le modèle australien, la restriction de l'accès aux contenus pornographiques en ligne passe principalement par la co-régulation entre les acteurs privés et les autorités gouvernementales. La loi sur la sécurité en ligne ( Part 9, Division 7 ) exige que les différentes branches de l'industrie numérique 36 ( * ) élaborent et adoptent de nouveaux codes de conduite pour prévenir ou limiter la diffusion de contenus potentiellement dangereux. Les codes de conduite et standards préexistants, adoptés en application de la loi sur les services audiovisuels de 1992, étaient en effet considérés comme dépassés, trop limités dans leur champ d'application et mal ou insuffisamment mis en oeuvre 37 ( * ) .

Ces codes de conduite doivent être enregistrés auprès du commissaire pour la sécurité en ligne eSafety . Les associations d'entreprises peuvent adopter une approche graduelle consistant à adopter d'abord le code relatif aux contenus les plus dangereux (classe 1) d'ici juillet 2022, puis les codes relatifs aux contenus inappropriés pour les enfants (classe 2) d'ici décembre 2022 38 ( * ) .

Suivant une approche fondée sur l'obligation de résultat plutôt que sur l'obligation de moyens, la loi sur la sécurité en ligne ne prescrit pas le contenu des codes de conduite mais fournit une longue liste d'exemples des questions pouvant y être traitées. Celles-ci entrent globalement dans trois catégories : i) les mesures visant à créer et maintenir un environnement en ligne sûr, ii) les mesures visant à donner les moyens aux usagers de gérer l'accès aux contenus de classe 1 et de classe 2 et iii) les mesures relatives à la transparence et à la responsabilité.

Le commissaire à la sécurité en ligne eSafety a publié onze recommandations, à l'aune desquelles il procède à l'enregistrement des codes de conduite, ainsi que des modèles de codes et des exemples de mesures attendues pour atteindre les résultats fixés. Dans la mesure du possible, les codes doivent « donner aux adultes australiens l'autonomie et le contrôle sur le contenu en ligne auquel ils peuvent accéder, qu'ils peuvent créer et partager » 39 ( * ) .

Les recommandations de

eSafety

pour

l'élaboration des codes de conduite

par l'industrie du

numérique

Contenu des codes

1. Les codes traitent des problèmes d'accès, d'exposition et de distribution des contenus de classe 1 et de classe 2.

2. L'application des codes ne doit pas être limitée aux services fournis à partir de l'Australie.

Conception des codes

3. Les associations de l'industrie élaborent un ensemble de principes de rédaction communs afin de faciliter l'élaboration des codes.

4. Les codes adoptent une approche réglementaire fondée sur les résultats et les risques, soutenue par des mesures de mise en conformité claire, s'appliquant aux acteurs de l'industrie dont les services ou appareils présentent le plus grand risque en ce qui concerne les contenus de classe 1 et de classe 2.

Élaboration des codes

5. Les associations de l'industrie préparent tous les codes pour un enregistrement d'ici juillet 2022 ou adoptent une approche progressive dans l'élaboration des codes. Dans le cadre de l'approche progressive, les codes traitant des contenus les plus dangereux doivent être déposés d'ici juillet 2022 et ceux traitant des contenus inappropriés pour les enfants d'ici décembre 2022.

6. Les associations de l'industrie limitent le nombre de codes élaborés.

Enregistrement des codes

7. Les associations de l'industrie s'engagent largement dans un dialogue avec les entreprises des branches du secteur afin de s'assurer qu'elles représentent de façon adéquate chaque branche couverte par un code.

8. Les associations de l'industrie mènent des consultations significatives auprès de l'industrie et du public.

9. Les associations de l'industrie engagement un dialogue avec eSafety tout au long du processus d'élaboration des codes.

Conformité et mise en oeuvre

10. Les participants de l'industrie traitent en premier ressort les rapports et les plaintes concernant les contenus de classe 1 et de classe 2 et la conformité aux codes. eSafety agira comme un « filet de sécurité » si la résolution d'une plainte n'est pas satisfaisante.

11. Les codes incluent une clause de révision (par exemple, 12 mois après leur adoption, puis tous les trois ans).

Source : eSafety, Industry Codes position paper, 2021

Concernant les moyens pour prévenir l'accès ou l'exposition des enfants à des contenus de classe 2 (dont les contenus pornographiques), eSafety cite les mesures suivantes : la mise en place de systèmes de vérification de l'âge, l'activation par défaut de paramètres de sécurité comme le mode de recherche sécurisée ou des procédures d'évaluation des risques et des impacts sur la sécurité qui tiennent spécifiquement compte des utilisateurs de moins de 18 ans. Pour ce qui concerne les hébergeurs de contenus de classe 2 en Australie , eSafety évoque comme mesures la conclusion de contrats avec les clients stipulant les exigences d'hébergement, la mise en place de fonctionnalités de signalement et de technologies de « hachage » 40 ( * ) efficaces.

Les entreprises du numérique sont responsables de la mise en oeuvre des codes de conduite et doivent traiter en premier ressort les plaintes des usagers. eSafety peut également recevoir des plaintes et enquêter sur d'éventuelles violations des codes (cf. infra).

Parallèlement, eSafety encourage les entreprises à adopter de façon volontaire l'initiative « sécurité par la conception » (Safety by Design initiative ) qui leur permet d'évaluer les risques pour la sécurité de leurs utilisateurs et, le cas échéant, leur propose des moyens pour améliorer celle-ci 41 ( * ) .

3. Les pouvoirs du commissaire à la sécurité en ligne « eSafety »

Créé en 2015, initialement uniquement pour les enfants, le commissaire à la sécurité en ligne eSafety est une agence gouvernementale indépendante spécifiquement dédiée à la sécurité en ligne. Son champ de compétences fut étendu aux adultes en 2017 et ses pouvoirs ont été significativement renforcés par la loi sur la sécurité en ligne de 2021. Outre ses rôles de coordination et de conseil auprès des entreprises et des citoyens, eSafety gère quatre mécanismes de plainte ou de signalement de contenus préjudiciables en ligne :

- un mécanisme anti-harcèlement en ligne ( cyberbullying ) pour les Australiens âgés de moins de 18 ans ;

- un mécanisme de plainte contre les abus en ligne ouvert aux adultes (nouvellement créé par la loi sur la sécurité en ligne de 2021) ;

- un mécanisme de plainte concernant les images intimes mises en ligne sans le consentement de la personne ( image-based abuse ) ;

- et un mécanisme de signalement et d'enquête concernant les contenus en ligne illégaux et restreints potentiellement dangereux (contenus de classe 1 et de classe 2).

Concernant les contenus illégaux et restreints, eSafety dispose de trois moyens gradués de mise en conformité ( Online Safety Act , Part 9, Divisions 3-4 ). L'agence peut émettre :

- des notifications informant les fournisseurs de services en ligne (réseaux sociaux ou autre service sur Internet) que eSafety a connaissance de la diffusion de contenus illégaux ou restreints, de classe 1 (contenus interdits), de classe 2A (pornographie sans violence) ou de classe 2B (contenus présentant des scènes de nudité, violence ou de drogue inappropriés pour les moins de 18 ans), à deux reprises ou plus au cours des douze derniers mois. Ces notifications ont un caractère informel et l'absence de réponse par les entreprises concernées n'entraîne aucune pénalité ;

- des demandes de retrait ( removal notice ) pour les contenus de classe 1 ou de classe 2A. Ces avis sont émis à la discrétion d' eSafety et peuvent être adressés au fournisseur ou à l'hébergeur de services en ligne. L'absence de mise en conformité, dans les 24 heures ou dans un délai plus long précisé par eSafety , peut entraîner une amende pouvant aller jusqu'à 500 unités de pénalités (111 000 dollars australiens, soit 74 495 euros) ;

- des demandes de mesure correctrice ( remedial notice ) exigeant de la part du fournisseur de service ou de l'hébergeur de prendre toutes les mesures nécessaires pour retirer les contenus de classe 2B disponibles sur son service ou mettre en place un système d'accès restreint, dans un délai de 24 heures ou plus défini par eSafety . La loi sur la sécurité en ligne de 2021 donne à eSafety le pouvoir de déterminer ce que constitue un système d'accès restreint. L'agence a publié sa décision en la matière en janvier 2022 42 ( * ) . En cas de non-respect de la décision, l'entreprise est passible d'une amende pouvant s'élever jusqu'à 500 unités de pénalités.

La définition des « systèmes

d'accès restreint »

(

Restricted Access

Systems

)

En application de la loi sur la sécurité en ligne, eSafety a adopté, en janvier 2022, une décision précisant les exigences minimales pour qu'un système soit reconnu comme un système d'accès restreint en vertu de la loi australienne :

« Le système de contrôle d'accès doit :

- exiger une demande d'accès au contenu et une déclaration du demandeur attestant qu'il est âgé d'au moins 18 ans ; et

- fournir des avertissements quant à la nature du contenu ; et

- fournir des informations de sécurité aux parents et aux tuteurs sur la manière de contrôler l'accès au contenu ; et

- intégrer des mesures raisonnables pour confirmer qu'un demandeur est âgé d'au moins 18 ans ; et

- limiter l'accès au contenu à moins que certaines étapes ne soient respectées, ce qui peut inclure l'utilisation d'un code PIN . »

Source : Online Safety (Restricted Access Systems) Declaration 2022

La loi sur la sécurité en ligne de 2021 donne également à eSafety le pouvoir de prononcer des demandes de suppression de liens ou de suppression d'applications donnant accès à des contenus de classe 1 (illicites), et ce, y compris pour les contenus diffusés ou hébergés depuis l'étranger et accessibles à des Australiens, ce qui constitue une nouveauté.

La portée des pouvoirs du commissaire à la sécurité en ligne concernant les contenus pornographiques (2A) ou inappropriés pour les moins de 18 ans (2B) est plus limitée. Les demandes de retrait ou mesures correctrices relatives à ce type de contenus ne peuvent concerner que les services fournis à partir de l'Australie 43 ( * ) . Les sites internet ou services fournis depuis l'étranger ne sont pas concernés.

Selon le rapport annuel d'activité de eSafety pour 2020-2021, l'action de l'agence s'est concentrée sur les contenus illicites (classe 1), en particulier ceux à caractère pédopornographique 44 ( * ) (14 633 enquêtes réalisées en 2020-2021 pour des contenus de classe 1, dont 98 % présentant des scènes d'abus sexuel d'enfants) 45 ( * ) . À la suite de ces enquêtes, il a été mis en évidence que deux contenus étaient hébergés en Australie, ce qui a donné lieu à une demande de retrait. Les autres contenus potentiellement interdits hébergés à l'étranger sont notifiés aux fournisseurs de filtres parentaux (appartenant au Family Friendly Filter scheme ) afin que l'accès à ces contenus soit bloqué pour les utilisateurs des filtres. Les contenus à caractère plus grave sont signalés aux forces de l'ordre. En revanche, le rapport ne fait pas état de décisions ou d'enquêtes d' eSafety concernant des contenus pornographiques en 2020-2021.

B. LE PROJET D'INTRODUCTION D'UN SYSTÈME DE VÉRIFICATION DE L'ÂGE POUR LA PORNOGRAPHIE

La loi sur la sécurité en ligne de 2021 ne prévoit pas l'introduction obligatoire d'un système de vérification de l'âge pour les contenus pornographiques. Cette question avait été débattue lors des travaux préparatoires au projet de loi. Le gouvernement avait néanmoins conclu que des analyses plus approfondies étaient nécessaires pour mettre en oeuvre un tel système en Australie 46 ( * ) .

Dans une contribution remise en novembre 2019 à la Chambre des Représentants, le commissaire à la sécurité en ligne eSafety avait recommandé de développer au préalable un écosystème numérique adéquat et d'adopter une approche proportionnée 47 ( * ) . « La vérification de l'âge est une solution possible pour traiter et minimiser l'accès des enfants et des jeunes à la pornographie en ligne. Cependant, pour résoudre efficacement le problème, il faudra une combinaison et une superposition de solutions technologiques » 48 ( * ) , comme le filtrage, le blocage par les fournisseurs d'accès à Internet, la sécurisation des réseaux Wifi ou des fonctionnalités de recherche sécurisée au sein des plateformes de contenus.

En mars 2020, la commission de la politique sociale et des affaires juridiques de la Chambre des Représentants a rendu un rapport, intitulé Protéger l'âge de l'innocence , sur la vérification de l'âge pour les paris et la pornographie en ligne 49 ( * ) . Dans ce rapport, les députés recommandent au gouvernement de charger le commissaire à la sécurité en ligne eSafety de l'élaboration rapide d'une feuille de route pour la mise en oeuvre d'un système obligatoire de vérification de l'âge. Cette recommandation a été soutenue par le gouvernement qui a officiellement demandé à eSafety , en juin 2021, de préparer cette feuille de route 50 ( * ) .

L'agence eSafety a réalisé, entre novembre 2021 et février 2022, une première phase de consultation de l'ensemble des parties prenantes (industries du divertissement pour adultes et du travail du sexe, plateformes et services en lignes, fournisseurs d'accès à Internet, chercheurs, ONG de défense du bien-être des enfants, de défense des droits numériques etc.) et lancé un appel à témoins 51 ( * ) . Ces travaux devraient s'achever en décembre 2022 avec la remise du rapport final au gouvernement. Selon la presse, les principales options technologiques envisagées par eSafety seraient les technologies de reconnaissance faciale et le programme d'identité numérique développé par l'Agence fédérale de transformation numérique ( Digital Transformation Agency (DTA) ) 52 ( * ) . Ce programme intitulé Trusted Digital Identity Framework (TDIF), déjà utilisé pour l'accès aux sites et services gouvernementaux, est actuellement en cours d'expérimentation pour restreindre l'accès aux jeux et à la vente d'alcool en ligne aux plus de 18 ans 53 ( * ) .

III. LE ROYAUME-UNI

Le Royaume-Uni tente depuis plusieurs années de limiter, voire d'empêcher l'accès des enfants aux contenus pornographiques.

En 2016, le ministère du numérique, de la culture, des médias et des sports avait ouvert une consultation sur la mise en place d'un dispositif de vérification de l'âge sur Internet. Le résultat de cette consultation montrait que les avis étaient partagés, avec 44 % des répondants en faveur d'un tel dispositif et 48 % qui étaient défavorables.

Le gouvernement britannique a toutefois conclu que « ne rien faire » n'était pas une option et que la vérification de l'âge, bien que « n'étant pas une panacée » 54 ( * ) , serait introduite via le projet de loi sur l'économie numérique.

Votée en 2017, la partie de cette loi sur la vérification de l'âge pour l'accès aux contenus pornographiques en ligne n'est pas entrée en vigueur. Un nouveau projet de loi, répondant aux mêmes objectifs, est actuellement en cours de discussion au parlement britannique.

A. LA TENTATIVE D'ENCADREMENT PAR LA LOI SUR L'ÉCONOMIE NUMÉRIQUE

Le Royaume-Uni a adopté en 2017 la loi sur l'économie numérique (Digital Economy Act) 55 ( * ) , dont l'un des objectifs consistait à limiter l'accès à la pornographie en ligne. La partie concernée de cette loi n'est cependant jamais entrée en vigueur.

1. Les dispositions de la loi sur l'économie numérique

La troisième partie de la loi sur l'économie numérique impose l'obligation aux sites internet pornographiques commerciaux d'empêcher l'accès des mineurs.

Pour contrôler cette obligation, la loi institue un régulateur chargé de la vérification de l'âge (age-verification regulator) , désigné par le secrétaire d'État, après une procédure parlementaire de validation. Cette fonction peut également être occupée par plusieurs personnes conjointement.

Le régulateur a le pouvoir :

- d'exiger des informations de la part d'un fournisseur de contenu internet ou de toute personne que le régulateur estime être impliquée dans la mise à disposition de matériel pornographique sur Internet à des fins commerciales au Royaume-Uni ;

- d'imposer des pénalités financières s'il estime que quelqu'un contrevient ou a contrevenu aux dispositions ou n'a pas satisfait à une obligation de fournir des informations. Cette pénalité ne peut être imposée si la faute a cessé et au-delà d'un délai de trois ans après sa commission. Le montant de la pénalité est fixé par le régulateur au niveau qu'il estime approprié. Il ne peut cependant pas excéder 250 000 livres (plus de 295 000 euros) ou 5 % du chiffre d'affaires admissible de la personne, selon ce qui est le plus élevé ;

- de notifier une contravention aux prestataires de services en matière de paiement (à l'instar de PayPal) et aux prestataires de services annexes, si ce tiers intervient dans le transfert des fonds dans le cadre d'un paiement pour l'accès à du matériel pornographique ou à du matériel interdit mis à disposition sur Internet par la personne contrevenante ;

- d'ordonner aux fournisseurs de services internet de bloquer l'accès au matériel. L'avis émis doit (i) identifier la personne contrevenante, (ii) indiquer l'infraction commise, (iii) demander au fournisseur de services internet de prendre les mesures précisées dans l'avis ou de mettre en place des dispositions qui paraissent appropriées au fournisseur afin d'empêcher l'accès au matériel incriminé, (iv) fournir toute information susceptible d'aider le fournisseur d'accès à Internet à se conformer à l'avis, (v) fournir des informations sur les modalités de recours, (vi) fournir tout autre détail que le régulateur juge approprié. Le fournisseur d'accès doit se conformer à toute exigence qu'il reçoit de la part du régulateur. Ce dernier doit cependant, au préalable, informer le secrétaire d'État et la personne contrevenante dans un avis motivé.

2. Un dispositif jamais mis en application

Si la loi a reçu la sanction royale ( royal assent ) en avril 2017, la partie 3 n'a cependant pas réellement été mise en application.

En février 2018, le secrétaire d'État a désigné le British Board of Film Classification (BBFC) comme régulateur chargé de la vérification de l'âge. Dans l'exercice de ses fonctions, le BBFC était censé (i) émettre des notifications exigeant des informations de la part des fournisseurs d'accès à Internet ou de toute autre personne impliquée dans la mise à disposition de pornographie en ligne au Royaume-Uni, (ii) émettre des mises en demeure lorsqu'une personne a contrevenu aux dispositions de la loi, (iii) notifier les prestataires de services de paiement et les prestataires de services auxiliaires lorsqu'une personne a enfreint les dispositions de la loi ou mis en ligne du matériel pornographique extrême au Royaume-Uni, (iv) émettre des mises en demeure aux fournisseurs d'accès à Internet leur demandant de bloquer l'accès lorsqu'une personne a enfreint les dispositions de la loi ou rendu du matériel pornographique extrême disponible en ligne au Royaume-Uni, (v) publier un rapport sur l'impact et l'efficacité de la vérification de l'âge et (vi) publier des lignes directrices sur les dispositifs de vérification de l'âge.

Le BBFC a ainsi publié en octobre 2018 des lignes directrices en matière de vérification de l'âge, dans lesquelles il énonçait les critères d'évaluation de la conformité aux exigences de la loi de 2017. Dans ces lignes directrices, le BBFC indiquait qu'il comptait adopter une « approche réglementaire proportionnée » . Il précisait également, s'agissant des normes en matière de vérification de l'âge, qu' « une gamme de solutions pour vérifier l'âge en ligne est actuellement disponible sur les services de pornographie hébergés au Royaume-Uni. Ces solutions s'appuient sur de nombreux ensembles de données, notamment la vérification de l'âge des cartes de crédit, des passeports, des permis de conduire et des téléphones portables. La vérification de l'âge est le plus souvent fournie par des prestataires tiers » 56 ( * ) .

Le BBFC précisait également les critères à partir desquels il examinerait si un dispositif de vérification de l'âge était conforme aux dispositions de la loi de 2017, à savoir :

- l'existence d'un mécanisme de contrôle efficace vérifiant que l'utilisateur final est âgé de 18 ans ou plus au moment de l'inscription ou de l'accès au contenu pornographique ;

- l'utilisation de données pour vérifier l'âge qui ne peuvent ni être raisonnablement connues d'une autre personne sans vol ou utilisation frauduleuse de données ou de documents, ni facilement obtenues ou prédites par une autre personne ;

- l'exigence selon laquelle chaque visite ou accès est subordonné à des contrôles, tels qu'un mot de passe ou des numéros d'identification personnels, et qu'un utilisateur doit être déconnecté par défaut, à moins qu'il ne demande à ce que ses informations de connexion soient mémorisées ;

- la présence de mesures qui authentifient les données de vérification de l'âge et de mesures efficaces pour empêcher l'utilisation par des robots ou algorithmes.

À l'inverse, ne sont pas suffisantes les mesures suivantes, prises isolément : (i) compter uniquement sur l'utilisateur pour confirmer son âge sans recouper les informations, par exemple en utilisant un système de case à cocher ou en demandant à l'utilisateur de saisir sa date de naissance, (ii) utiliser une clause de non-responsabilité générale telle que « toute personne utilisant ce site Web sera considérée comme ayant plus de 18 ans », (iii) accepter la vérification de l'âge par l'utilisation de méthodes de paiement en ligne qui ne requièrent pas que l'utilisateur ait plus de 18 ans et (iv) vérifier avec des informations facilement accessibles au public ou facilement connues telles que le nom, l'adresse et la date de naissance.

Les dispositions relatives à la vérification de l'âge devaient entrer en vigueur le 15 juillet 2019. Toutefois, en juin 2019, le gouvernement britannique a tout d'abord annoncé que la mise en oeuvre de cette partie de la loi serait retardée d'environ six mois, en raison d'un défaut d'information à la Commission européenne. En octobre 2019, le gouvernement a finalement indiqué que la partie 3 n'entrerait pas en vigueur mais que les objectifs de la loi seraient atteints via de nouvelles propositions du gouvernement pour lutter contre les nuisances en ligne 57 ( * ) .

B. UNE NOUVELLE RÉPONSE EN COURS D'ÉLABORATION

Après avoir annoncé que la partie 3 de la loi sur l'économie numérique n'entrerait pas en vigueur, le gouvernement a fait part de son intention de l'abroger en octobre 2020. En parallèle, un autre dispositif-cadre a été imaginé, à la suite de la publication d'un livre blanc sur les nuisances en ligne (online harms white paper) .

1. Le livre blanc sur les nuisances en ligne

Le livre blanc sur les nuisances en ligne répond à l'ambition de faire du Royaume-Uni « l'endroit le plus sûr au monde pour aller sur Internet » et présente les mesures envisagées par le gouvernement britannique en matière de sécurité en ligne. Ce paquet regroupe des mesures législatives et non législatives afin de rendre les entreprises plus responsables de la sécurité de leurs utilisateurs en ligne, en particulier les enfants et autres groupes vulnérables.

Le livre blanc propose d'inscrire dans la loi un nouveau devoir de vigilance envers les usagers, qui sera supervisé par un régulateur indépendant. Les entreprises seront tenues responsables de la lutte contre un ensemble complet de préjudices en ligne, allant des activités et contenus illégaux aux comportements nuisibles mais pas nécessairement illégaux.

Une consultation publique a été ouverte entre avril et juillet 2019 pour recueillir les points de vue sur divers aspects de ce plan, notamment concernant (i) les services en ligne qui entreraient dans le champ d'application, (ii) les options offertes en matière de nomination d'un organisme indépendant pour mettre en oeuvre, superviser et faire respecter le nouveau cadre réglementaire, (iii) les pouvoirs dont disposerait un tel organisme, (iv) les mécanismes de recours ouverts aux utilisateurs et (v) les mesures visant à garantir que le dispositif est ciblé et proportionné.

Dans sa réponse à la consultation publique, le gouvernement britannique a indiqué que :

- sont notamment concernées « les catégories de contenus et d'activités préjudiciables affectant les enfants, telles que la pornographie ou les contenus violents » 58 ( * ) ;

- le dispositif a vocation à être le plus complet possible pour protéger les enfants. En particulier, il reprendra les objectifs de la partie 3 de la loi sur l'économie numérique pour protéger les enfants contre l'accès à la pornographie en ligne, mais aussi contre un éventail plus large de contenus préjudiciables et inappropriés pour leur âge. Les entreprises visées devront évaluer la probabilité que les enfants accèdent à leurs services ;

- seuls les services susceptibles d'être accessibles aux enfants devront se doter de protections supplémentaires. Cette approche est celle adoptée dans l' Age Appropriate Design Code59 ( * ), qui oblige les entreprises à appliquer les 15 normes du code pour la protection des données personnelles des enfants, lorsqu'elles ont évalué que les enfants sont « susceptibles d'accéder » à leur service ;

- l'Office des communications (OFCOM) sera l'autorité de régulation en charge des contenus nuisibles sur Internet.

La réponse du gouvernement à la consultation publique précise que « le cadre réglementaire créera une obligation légale, pour les entreprises exploitant des services susceptibles d'être accessibles aux enfants, de fournir un niveau de protection plus élevé pour les enfants, de prendre des mesures raisonnables pour les empêcher d'accéder à des contenus inappropriés pour leur âge ou préjudiciables, et pour les protéger d'autres activités nuisibles. Cela comprend le fait d'être la cible de délinquants (par exemple, dans les cas d'exploitation sexuelle et d'abus d'enfants). L'approche différenciée met l'accent sur la sécurité des enfants en ligne. Toutes les entreprises visées seront tenues d'évaluer si leur service est susceptible d'être utilisé par des enfants et, le cas échéant, de prendre des mesures pour les protéger. (...) Le gouvernement s'attend à ce que le régulateur accorde la priorité à la protection des enfants dans son approche des mesures d'application » 60 ( * ) .

Le nouveau dispositif législatif fait partie du projet de loi sur la sécurité en ligne, déposé le 17 mars 2022 devant le parlement 61 ( * ) .

2. Le projet de loi sur la sécurité en ligne

À la suite des conclusions du livre blanc, un texte sur la sécurité en ligne a été publié en mai 2021 sous la forme d'un avant-projet. Un comité mixte de députés et de pairs a été créé en juillet 2021 pour effectuer un examen pré-législatif. Ce comité mixte a entendu plus de 50 témoins et a reçu plus de 200 pièces écrites, puis a publié un rapport et des recommandations en décembre 2021. En réponse, le gouvernement a modifié l'avant-projet de loi puis a déposé le projet ainsi modifié le 17 mars 2022. Ce texte est actuellement en cours de discussion à la chambre des Communes.

Dans sa version actuelle, ce projet de loi propose d'imposer des obligations (duties) aux fournisseurs de services internet ou de moteurs de recherche en matière de contenu illégal, de contenu préjudiciable aux enfants et de contenu légal mais préjudiciable aux adultes. Tous les services devraient protéger les utilisateurs contre les contenus illégaux, avec des devoirs supplémentaires pour les services susceptibles d'être accessibles aux enfants, dans la mesure où ils ont un lien avec le Royaume-Uni. Tous les services fournissant du contenu pornographique auraient le devoir d'empêcher les enfants d'accéder à ce matériel (par exemple, par la vérification de l'âge).

Outre l'objectif général selon lequel les fournisseurs de contenus pornographiques en ligne ont l'obligation de veiller à ce que les enfants ne soient « normalement pas en mesure de rencontrer » ce contenu (par exemple en utilisant la vérification de l'âge), il y aurait également une obligation « d'établir et de conserver une trace écrite sous une forme facilement compréhensible » (i) des mesures prises et des politiques mises en oeuvre pour se conformer à l'obligation de non-accessibilité et (ii) de la manière dont le fournisseur, lorsqu'il a décidé et mis en oeuvre les mesures et politiques nécessaires, a tenu compte de l'importance de protéger les utilisateurs du Royaume-Uni contre une violation de toute disposition légale ou règle de droit concernant la confidentialité.

L'OFCOM serait chargée de publier des lignes directrices sur la manière de se conformer à ces obligations. L'OFCOM sera également dotée de pouvoirs d'exécution lui permettant d'infliger des amendes pouvant atteindre 18 millions de livres (21,2 millions d'euros) ou 10 % du chiffre d'affaires mondial de l'entreprise (selon le montant le plus élevé), ainsi que des mesures de restriction des activités après demande auprès d'un tribunal.

* 1 Strafgesetzbuch (StGB), § 184 Verbreitung pornographischer Inhalte

* 2 Jugendschutzgesetz (JuSchG)

* 3 Staatsvertrag über den Schutz der Menschenwürde und den Jugendschutz in Rundfunk und Telemedien (Jugendmedienschutz-Staatsvertrag - JMStV)

* 4 Presque chaque Land possède sa propre autorité régulatrice des médias, à l'exception des Länder de Berlin et de Brandebourg, qui partagent une autorité commune, tout comme Hambourg et le Land de Schleswig-Holstein. Au total, il existe donc 14 autorités régulatrices des médias, qui coopèrent pour la définition de lignes directrices communes au sein de commissions centrales.

* 5 Sont définis comme prestataires de services au sens de la loi du 26 février 2007 sur le numérique, toute personne physique ou morale qui met à disposition son propre service d'information et de communication électronique (Telemedien) autre qu'un service de télécommunication classique ou audiovisuel, ou celui d'un tiers, ou fournit un accès à leur utilisation. Entrent notamment dans cette catégorie les services de vente en ligne, les plateformes de vidéo qui ne sont pas liées à une chaîne télévisée, les moteurs de recherche sur Internet mais aussi les fournisseurs d'accès.

* 6 Définis à l'article 5 de l'accord des Länder.

* 7 Gesetz zur Verbesserung der Rechtsdurchsetzung in sozialen Netzwerken (Netzwerkdurchsetzungsgesetz - NetzDG), § 3 .

* 8 Dans ce dernier cas, le prestataire de services est soumis aux obligations prévues par les articles 54 et suivants de l'accord des Länder sur l'audiovisuel.

* 9 Créée en 2021, à l'occasion de la révision législative en remplacement du Centre fédéral de contrôle des médias portant atteinte aux jeunes (Bundesprüfstelle für jugendgefährdende Medien).

* 10 https://www.bzkj.de/bzkj/ueberuns/aufgaben

* 11 Le droit allemand considère comme un enfant tout mineur de moins de 14 ans et comme un adolescent un mineur âgé de 14 ans ou plus et de moins de 18 ans.

* 12 La KJM reconnaît quatre organismes d'autorégulation : FSF, compétente pour la télévision et les plateformes de vidéo en ligne, FSM dans le domaine des services multimédias, FSK.online pour l'industrie du film en ligne et USK.online pour les programmes informatiques.

* 13 La KJM ne communique que sur les évaluations ayant abouti à un résultat positif de conformité avec les exigences de protection de la jeunesse.

* 14 https://www.kjm-online.de/aufsicht/technischer-jugendmedienschutz/unzulaessige-angebote/altersverifikationssysteme

* 15 https://www.kjm-online.de/fileadmin/user_upload/KJM/Aufsicht/Technischer_Jugendmedienschutz/KJM-AVS-Raster.pdf

* 16 https://www.kjm-online.de/service/pressemitteilungen/meldung/kjm-bewertet-sieben-weitere-altersverifikationssysteme-positiv-1

* 17 https://www.kjm-online.de/service/pressemitteilungen/meldung/kjm-bewertet-yoti-age-scan-als-technisches-mittel-positiv

* 18 KJM, Tätigkeitsbericht März 2019 - Februar 2021, p. 59.

* 19 https://www.fsm.de/online-jugendschutz/jugendmedienschutz-in-der-praxis/

* 20 https://www.kjm-online.de/service/pressemitteilungen/meldung?tx_news_pi1%5Bnews%5D=4826&cHash=faf6ef201d23b877624d67cb61f0a121

* 21 https://www.jugendschutz.net/ueber-uns/wer-wir-sind

* 22 Selon l'hebdomadaire Die Zeit, les trois sites concernés sont Pornhub, Youporn et Mydirtyhobby.

Voir : https://www.zeit.de/digital/internet/2020-06/pornografie-minderjaehrige-medienschutz-pornoplattform-sperre?page=11

* 23 https://www.kjm-online.de/service/pressemitteilungen/meldung?tx_news_pi1%5Bnews%5D=4826&cHash=faf6ef201d23b877624d67cb61f0a121

* 24 Verwaltungsgericht Düsseldorf, 27 L 1414/20

* 25 https://www.kjm-online.de/service/pressemitteilungen/meldung/kjm-beschliesst-sperrung-von-xhamster

* 26 https://www.kjm-online.de/themen/vorgehen-porno-portale

* 27 Bundeszentrale für Kinder- und Jugendmedienschutz - Gefährdungsatlas p. 175.

* 28 https://www.esafety.gov.au/about-us/who-we-are

* 29 https://www.legislation.gov.au/Details/C2021A00076

* 30 Ces dispositions abrogent les annexes 5 et 7 du Broadcasting Services Act de 1992.

* 31 Le National Classification Scheme est un accord de coopération entre le gouvernement australien et les gouvernements des États et des territoires.

* 32 Les contenus de classe 2B incluent certains contenus pornographiques mais embrassent des types de contenus plus variés.

* 33 https://www.classification.gov.au/classification-ratings/what-do-ratings-mean#MA

* 34 Online Safety Act, Part 4, Division 2, Section 46.

* 35 Afin de tenir compte des Basic Online Safety Expectations de la loi, l'entreprise Google a annoncé en mars 2022 son intention d'exiger la présentation d'une pièce d'identité ou d'une carte de crédit de la part des utilisateurs de YouTube et de GooglePlay tentant d'accéder à certains contenus pour adultes en Australie.

https://www.itnews.com.au/news/google-rolling-out-age-verification-on-youtube-play-store-in-australia-577499

* 36 À savoir les fournisseurs de réseaux sociaux, boîtes de messagerie électronique, messagerie instantanée, jeux, services de rencontres, moteurs de recherche, fournisseurs d'applications, fournisseurs d'accès à Internet, hébergeurs de sites ainsi que les fabricants et fournisseurs d'équipements utilisés pour accéder aux services en ligne.

* 37 Lynelle Briggs AO, Report of the Statutory Review of the Enhancing Online Safety Act 2015 and the Review of Schedules 5 and 7 to the Broadcasting Services Act 1922 (Online Content Scheme), October 2018,

https://www.infrastructure.gov.au/sites/default/files/briggs-report-stat-review-enhancing-onlinesafety-act2015.pdf.

* 38 eSafety Commissioner, Development of Industry codes under the Online Safety Act, September 2021, https://www.esafety.gov.au/sites/default/files/2021-09/eSafety%20Industry%20Codes%20Position%20Paper.pdf

* 39 Ibid.

* 40 Utilisées en informatique et en cryptographie, les fonctions de hachage permettent, à partir d'une donnée fournie en entrée, de calculer une empreinte numérique servant à identifier rapidement la donnée initiale.

* 41 https://www.esafety.gov.au/industry/safety-by-design

* 42 Online Safety (Restricted Access Systems) Declaration 2022,

https://www.legislation.gov.au/Details/F2022L00032/Explanatory%20Statement/Text

* 43 Pour vérifier si cette condition est remplie, eSafety prend en compte différents facteurs comme l'hébergement du site en Australie ou l'inscription du fournisseur de services au registre des entreprises australiennes.

* 44 Dans le cadre du réseau International Association of Internet Hotlines (INHOPE) qui a pour but de combattre la diffusion d'images présentant des scènes d'abus sexuel des enfants.

* 45 https://www.esafety.gov.au/sites/default/files/2021-10/ACMA%20and%20eSafety%20annual%20report%202020-21_0.pdf

* 46 Online Safety Bill 2021, Explanatory memorandum, p. 39,

https://parlinfo.aph.gov.au/parlInfo/download/legislation/ems/r6680_ems_3499aa77-c5e0-451e-9b1f-01339b8ad871/upload_pdf/JC001336%20Clean4.pdf;fileType=application%2Fpdf

* 47 https://www.aph.gov.au/DocumentStore.ashx?id=2c35bb2c-4a68-428b-af67-cf05ff17052e&subId=673265

* 48 Ibid.

* 49 https://www.aph.gov.au/Parliamentary_Business/Committees/House/Social_Policy_and_Legal_Affairs/Onlineageverification/Report

* 50 Australian Government response to the House of Representatives Standing Committee on Social Policy and Legal Affairs report “Protecting the Age of Innocence”,

https://www.aph.gov.au/Parliamentary_Business/Committees/House/Social_Policy_and_Legal_Affairs/Completed_inquiries

* 51 https://www.esafety.gov.au/about-us/consultation-cooperation/age-verification

* 52 https://www.lismorecitynews.com.au/story/7596265/hushed-talks-over-expansion-of-age-checks-for-online-pornography/

* 53 https://www.canberratimes.com.au/story/7445505/mastercard-joins-up-with-govt-digital-agency-for-age-verification-push/

* 54 https://researchbriefings.files.parliament.uk/documents/CBP-8551/CBP-8551.pdf

* 55 https://www.legislation.gov.uk/ukpga/2017/30/contents

* 56 https://researchbriefings.files.parliament.uk/documents/CBP-8551/CBP-8551.pdf

* 57 https://questions-statements.parliament.uk/written-statements/detail/2019-10-16/HCWS13

* 58 https://www.gov.uk/government/consultations/online-harms-white-paper/outcome/online-harms-white-paper-full-government-response

* 59 https://ico.org.uk/for-organisations/guide-to-data-protection/ico-codes-of-practice/age-appropriate-design-code/

* 60 https://www.gov.uk/government/consultations/online-harms-white-paper/outcome/online-harms-white-paper-full-government-response

* 61 https://bills.parliament.uk/bills/3137